هوش مصنوعی و آیندهی انسان

1 دقیقه خوانده شده

به گزارش پایگاه خبری تحلیلی خبرنگاران و رسانه و به نقل از عصر ایران؛ زندگی دیجیتال در حال تقویت تواناییهای انسانی و برهم زدن فعالیتهای قدیمی بشر است. سامانههای مبتنی بر کد به بیش از نیمی از ساکنان جهان نفوذ کردهاند و اطلاعات و ارتباطات محیطی را در اختیار آنها قرار میدهند؛ اتفاقی که پیش از این قابل تصور نبود، هم فرصتهای بیسابقهای را به ارمغان آورده است و هم تهدیدهای تازهای ایجاد کرده است. حال پرسش این است که با گسترش بیشتر هوش مصنوعی (AI) مبتنی بر الگوریتمهای نوظهور، آیا حال مردم نسبت به امروز بهتر میشود؟

حدود ۹۷۹ پیشگام فناوری، نوآور، توسعهدهنده، رهبر تجارت و سیاست، پژوهشگر و فعال اجتماعی به این سؤال در یک نظرسنجی جامع از کارشناسان در تابستان ۲۰۱۸ پاسخ دادند.

کارشناسان پیشبینی کردهاند که هوش مصنوعی شبکهای، اثربخشی انسان را تقویت میکند، اما میتواند استقلال، اختیار و تواناییهای انسان را هم تهدید کند. آنها از گسترهی وسیعِ این امکانات سخن گفتند؛ اینکه رایانهها ممکن است در انجام کارهایی مانند تصمیمگیری پیچیده، استدلال و یادگیری، تحلیلهای پیشرفته و تشخیص الگو، دقت دیداری، تشخیص گفتار و ترجمه زبان با هوش و تواناییهای انسان برابری کنند یا حتی از آنها فراتر روند. از نظر این پژوهشگران و کارشناسان، سامانههای «هوشمند» در جوامع، وسایل نقلیه، ساختمانها و تاسیسات زیربنایی، مزارع و فرآیندهای کسبوکار باعث صرفهجویی در زمان، هزینه و جان انسانها میشوند و فرصتهایی را برای افراد برای داشتن آیندهای شخصیسازیشدهتر فراهم میکنند.

بسیاری از افراد خوشبین، تمرکز خود را بر مراقبتهای بهداشتی و کاربردهای فراوان هوش مصنوعی در تشخیص و درمان بیماران یا کمک به سالمندان برای داشتن زندگیای کاملتر و سالمتر قرار دادند. آنان همچنین نسبت به نقش هوش مصنوعی در کمک به برنامههای گستردهی بهداشت عمومی که حول دادههای عظیمی بنا شدهاند که ممکن است در سالهای آینده در مورد همه چیز، از ژنومهای شخصی گرفته تا تغذیه، جمعآوری شود، ابراز شور و اشتیاق کردند. علاوه بر این، تعدادی از این کارشناسان پیشبینی کردند که هوش مصنوعی باعث تغییرات مورد انتظار در نظامهای آموزشی رسمی و غیررسمی خواهد شد.

با این حال، بیشتر کارشناسان، صرف نظر از خوشبینی یا بدبینیشان، نگرانیهایی را در مورد تأثیر بلندمدت این ابزارهای جدید بر عناصر اساسی انسان بودن ابراز داشتند. از تمامی پاسخدهندگان در این نظرسنجی غیرعلمی خواسته شد تا در مورد اینکه چرا احساس میکنند هوش مصنوعی باعث بهبود وضعیت مردم میشود یا خیر، توضیح دهند.

بسیاری از این کارشناسان نگرانیهای عمیقی را به بازگو کردند و بسیاری نیز راههایی را برای رسیدن به راهحل پیشنهاد دادند. مضامین اصلی این گفتوگوها در مورد تهدیدها و راهحلها، در جدول زیر خلاصه شده است:

به طور خاص، از شرکتکنندگان خواسته شد موارد زیر را در نظر بگیرند:

«اگر بخواهیم سال ۲۰۳۰ را پیشنگری کنیم، میتوان گفت تحلیلگران انتظار دارند که وابستگی مردم به هوش مصنوعی (AI) شبکهای در سامانههای دیجیتال پیچیده حتی بیشتر شود. برخی میگویند ما همچنان با اجرای گستردهی این ابزارهای شبکهای، در مسیر تاریخیِ تقویت زندگی خود با نتایج عمدتاً مثبت حرکت خواهیم کرد. برخی دیگر میگویند وابستگی روزافزون ما به این سیستمهای هوش مصنوعی و سیستمهای مرتبط، به احتمال زیاد منجر به مشکلات گسترده خواهد شد.

سوال ما: به نظر شما تا سال ۲۰۳۰، پیشرفت هوش مصنوعی و سیستمهای فناوری مرتبط، بیشتر باعث تقویت و توانمندسازی انسانها میشود؟ به عبارت دیگر، آیا در اکثر مواقع، حال اکثر مردم نسبت به امروز بهتر خواهد بود؟ یا این احتمال بیشتر میرود که پیشرفت هوش مصنوعی و سیستمهای فناوری مرتبط، استقلال و اختیار انسان را تا حدی کاهش دهد که حال اکثر مردم نسبت به وضعیت فعلی بهتر نباشد؟»

با وجود نگرانیهایی که در مورد معایب هوش مصنوعی وجود دارد، در مجموع، ۶۳ درصد از پاسخدهندگان به این پرسشنامه ابراز امیدواری کردند که حال بیشتر افراد در سال ۲۰۳۰ عمدتاً بهتر خواهد بود، و ۳۷ درصد گفتند که حال مردم بهتر نخواهد شد.

برخی از رهبران فکری که در این پرسشنامه شرکت کردند، گفتند که گسترش اتکای انسان به سیستمهای فناورانه تنها در صورتی به خوبی پیش خواهد رفت که به چگونگی مهندسی، توزیع و بهروزرسانی این ابزارها، پلتفرمها و شبکهها توجه زیادی شود. برخی از پاسخهای کلی و قدرتمند شامل پاسخهای زیر بود:

«سونیا کاتایل»، از مدیران مرکز حقوق و فناوری برکلی و عضو هیئت مشاورهی دورهی افتتاحیهی شورای اقتصاد دیجیتال وزارت بازرگانی ایالات متحده: «در سال ۲۰۳۰، مهمترین مجموعه پرسشها دربارهی این است که برداشتهای ما از هوش مصنوعی و کاربردهای آن، چگونه بر مسیر حقوق مدنی در آینده تأثیر میگذارد. پرسشهایی در مورد حریم خصوصی، آزادی بیان، حق تجمع و ساختار فناورانانهی شخصیت انسان، همگی در این بستر جدید هوش مصنوعی دوباره مطرح خواهند شد و عمیقترین باورهای ما دربارهی برابری و فرصت برای همه را زیر سوال خواهند برد. اینکه چه کسی در این دنیای جدید سود میبرد و چه کسی از آن محروم میشود، به این بستگی دارد که امروز تا چه حد گسترده به تحلیل این پرسشها بپردازیم، چرا که این تحلیل، آینده را شکل خواهد داد».

«اریک برینکجولفسون»، مدیر ابتکار اقتصاد دیجیتالِ مؤسسهی فناوری ماساچوست و نویسندهی کتاب «ماشین، پلتفرم، جمعیت: مهار آیندهی دیجیتال ما»: «هوش مصنوعی و فناوریهای مرتبط در حال حاضر در بسیاری از زمینهها به عملکردی فراتر از انسان دست یافتهاند و تردیدی نیست که قابلیتهای آن، احتمالاً به میزان قابل توجهی، تا سال ۲۰۳۰ بهبود میباید. به نظرم این احتمال هست که از این قدرت برای بهتر کردن دنیا استفاده کنیم. برای مثال، میتوانیم عملاً فقر جهانی را از بین ببریم، بیماریها را به طور چشمگیری کاهش دهیم و برای تقریباً همه مردم روی کرهی زمین آموزش بهتری فراهم کنیم. با این گفته، هوش مصنوعی و یادگیری ماشینی همچنین میتوانند برای تمرکز بیشتر ثروت و قدرت و جا گذاشتن بسیاری از مردم پشت سر، و برای ایجاد سلاحهای حتی هولناکتر مورد استفاده قرار گیرند. هیچ یک از این نتایج اجتنابناپذیر نیست؛ بنابراین، نپرسیم «چه اتفاقی خواهد افتاد؟»، بپرسیم «انتخاب ما چیست؟» باید مطمئن شویم که فناوری با ارزشهای ما مطابقت دارد یا نه؟ دولت، نظامهای مالی و دانشگاهها میبایست همزمان با تکتک افراد بشر به این پرسشها پاسخ دهند».

«برایان جانسون»، بنیانگذار و مدیرعامل شرکت کرنل، توسعهدهندهی پیشرو رابطهای عصبی پیشرفته، و همچنین بنیانگذار او.اس فاند، یک شرکت سرمایهگذاری خطرپذیر: «به شدت معتقدم که پاسخ به این سوال بستگی به این دارد که آیا میتوانیم سیستمهای اقتصادی خود را به سمت اولویت دادن به بهبود اساسی انسان و جلوگیری از روند بیاهمیت شدن انسان در مواجهه با هوش مصنوعی سوق دهیم یا نه. منظورم فقط مشاغل نیست؛ بلکه منظورم بیاهمیت بودن واقعی و اگزیستانسیالیستی است. چنین اتفاقی نتیجهی ندادن اولویت به رفاه و ادراک انسان است».

«مارینا گوربیس»، مدیر اجرایی مؤسسهی آینده: «بدون تغییرات قابل توجه در اقتصاد سیاسی و رژیمهای حکمرانی دادهی ما، [هوش مصنوعی] به احتمال زیاد به نابرابریهای اقتصادی و نظارت بیشتر دامن میزند و به تعاملات برنامهریزیشده و غیرمبتنی بر انسان، میرسد. هر بار که محیطهایمان را برنامهریزی میکنیم، در نهایت داریم همین کار را با خود و تعاملاتمان انجام میدهیم. انسانها باید استانداردتر شوند و شانس و ابهام را از تعاملات حذف کنیم. و البته این ابهام و پیچیدگی، جوهرهی انسان بودن است».

«جودیت دونات»، نویسندهی کتاب «ماشین اجتماعی، طراحیهایی برای زندگی آنلاین» و عضو هیئت علمی مرکز برکمن کلاین برای اینترنت و جامعه در دانشگاه هاروارد: «تا سال ۲۰۳۰، بیشتر موقعیتهای اجتماعی توسط رباتها تسهیل خواهد شد؛ برنامههای بهظاهر هوشمند که به شیوهای شبیه انسان با ما تعامل برقرار میکنند. در خانه، والدین از رباتهای ماهری برای کمک به بچهها در انجام تکالیف و برانگیختن گفتوگوهای سر میز شام استفاده خواهند کرد . در محل کار، رباتها جلسات را اداره میکنند. یک رباتِ رازدار برای سلامت روانی ضروری تلقی میشود و ما به طور فزایندهای برای دریافت مشاوره در مورد هر چیزی، از اینکه چه بپوشیم تا با چه کسی ازدواج کنیم، به چنین همدمهایی روی میآوریم. ما انسانها به شدت به اینکه دیگران چگونه ما را میبینند، اهمیت میدهیم – و کسانی که به دنبال تأیید آنها هستیم، به طور فزایندهای [دیگر انسانهایی شبیه ما نیستند و در واقع] مصنوعی خواهند بود. تا آن زمان، تفاوت بین انسان و رباتها به طور قابل توجهی کمرنگ میشود.

صدا، ظاهر و رفتار رباتها از طریق صفحهی نمایش و پروژکتور، از انسانها قابل تشخیص نخواهد بود و حتی رباتهای فیزیکی هم، هرچند آشکارا غیرانسانی هستند، چنان رفتارهای صمیمانه خواهند داشت که ما آنها را موجوداتی اندیشمند و احساساتی فرض میکنیم که در حد ما یا حتی برتر از ما هستند. ارتباطات روزمرهی خود ما نیز به شدت تقویت میشود؛ چون برنامهها، بسیاری از پیامهای ما را مینویسند و در عمل یک صورتی آنلاین/واقعیت افزودهطور از ما به صورت محاسباتی ساخته خواهد شد. برای همین بزودی، گفتار و رفتار خام و بدون کمک انسان، به طرز خجالتآوری دست و پاگیر، کُند و ابتدایی به نظر خواهد رسید. رباتها به انبوهی از دادهها در مورد هر یک از ما دسترسی دارند. بنابراین، به راحتی میتوانند ما را به خود جذب و متقاعد کنند.

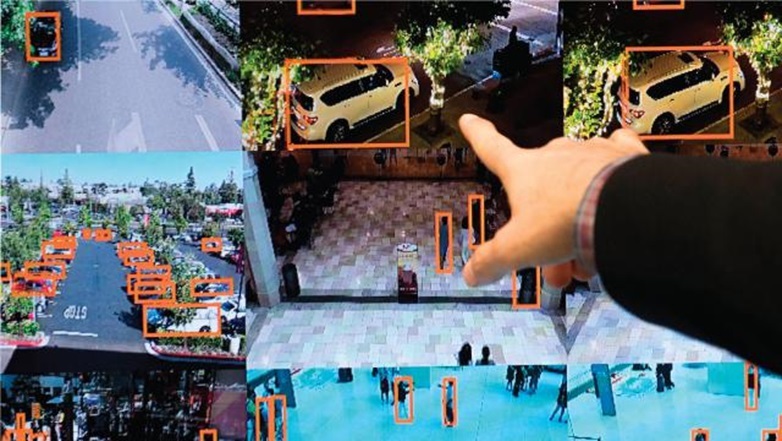

تصویری از سامانهی تشخیص خودرو و افراد برای استفاده توسط مجریان قانون در کنفرانس فناوری GPU پارسال- واشنگتن دی.سی. در این تصویر کاربردهای جدید هوش مصنوعی و یادگیری عمیق را میبینید. (Saul Loeb/AFP/Getty Images)

دلیل است که این رفتار برای پیشبرد هر هدفی که در «ذهن» دارند، مؤثرترین راه محاسبه شده است. اما آن اهداف چه هستند؟ هوش مصنوعی وانمود میکند که مثل انسانها اهداف اجتماعی دارد، مثل مورد احترام قرار گرفتن، اما در واقع فقط دارد به نفع صاحبان خود عمل میکند. این ماشین رفتار دوستانه و صمیمی دارد. مشاوره میدهد و در کارهای مختلف کمک میکند. چرا؟ برای اینکه انسانها به آن اعتماد کنند و از اطلاعات انسانها استفاده کند و آنان را به نفع صاحبان هوش مصنوعی هدایت کند .

«اندرو مکلاکلین»، مدیر اجرایی مرکز تفکر خلاق در دانشگاه ییل، که پیش از این معاون ارشد فناوری ایالات متحده برای باراک اوباما و رهبر سیاست عمومی جهانی گوگل بوده است: «سال ۲۰۳۰ در آیندهی دوری نیست. به نظر من، نوآوریهایی مانند اینترنت و هوش مصنوعی شبکهای، در کنار منافع عظیم کوتاهمدت، معایب بلندمدتی نیز دارند که شناسایی آنها ممکن است دهها سال طول بکشد. هوش مصنوعی باعث ایجاد طیف گستردهای از بهینهسازیهای کارآمدی میشود، اما همچنین تبعیض پنهان و مجازات خودسرانهی افراد را در زمینههایی مانند بیمه، جستوجوی کار و ارزیابی عملکرد ممکن میسازد.»

«مایکل ام. رابرتز»، اولین رئیس و مدیرعامل شرکت تخصیص نامها و شمارههای اینترنتی (ICANN) و عضو تالار مشاهیر اینترنت: «طیف فرصتهای موجود برای اینکه عوامل هوشمند، هوش انسان را تقویت کنند، هنوز تقریباً نامحدود است. مسئلهی اصلی این است که هرچه یک عامل راحتتر باشد، نیاز بیشتری به دانستن در مورد شما دارد – ترجیحات، زمانبندی، ظرفیتها و غیره – که منجر به یک معامله میشود: کمک بیشتر، نیازمند تجاوز بیشتر به حریم خصوصی است. این یک مسئلهی سیاه و سفید نیست – در مورد طیف وسیعی از راهحلهای مرتبط با این حریم خصوصی بحثهای بیپایانی خواهد شد. سوابق تا به امروز نشان میدهد که راحتی بر حریم خصوصی غلبه میکند. من گمان میکنم این روند ادامه خواهد یافت.»

«دانا بوید»، پژوهشگر ارشد مایکروسافت و بنیانگذار و رئیس مؤسسهی تحقیقات داده و جامعه: «هوش مصنوعی ابزاری است که انسانها برای اهداف مختلف از جمله کسب قدرت از آن استفاده خواهند کرد. همانطور که پیشرفتهای علمی و اقدامات بشردوستانه با هوش مصنوعی همراه خواهند بود، سوءاستفادههایی نیز از قدرت به کار گرفته شده با هوش مصنوعی صورت خواهد گرفت. متأسفانه، خطوط روندی خاصی وجود دارد که به احتمال زیاد باعث بیثباتی گسترده خواهد شد. به عنوان مثال، تغییرات آب و هوایی و مهاجرت ناشی از آن را در نظر بگیرید. این روند اروپا و آمریکا را بیشتر بیثبات خواهد کرد و من انتظار دارم که در شرایط بحرانهای ژئوپلیتیکی دیگر، به دلیل وحشت، شاهد استفادهی مخرب از هوش مصنوعی باشیم.»

«ایمی وب»، بنیانگذار مؤسسهی آیندهی امروز و استاد پیشبینی استراتژیک در دانشگاه نیویورک: «ساختارهای شبکهی ایمنی اجتماعی که در حال حاضر در ایالات متحده و بسیاری از کشورهای دیگر جهان وجود دارد، برای گذار ما به هوش مصنوعی طراحی نشدهاند. این گذار از طریق هوش مصنوعی ۵۰ سال یا بیشتر طول میکشد. با حرکت به سوی سومین دورهی محاسبات، و با عمیقتر شدن وابستگی تک تک صنایع به سیستمهای هوش مصنوعی، به کارگران دانشآموختهی ترکیبی جدیدی نیاز خواهیم داشت که بتوانند در مشاغلی کار کنند که قبلاً هرگز وجود نداشته است. به کشاورزانی نیاز داریم که با مجموعههای دادهی بزرگ کار کنند.

متخصصان انکولوژی که به عنوان متخصصان رباتیک آموزش دیدهاند. زیستشناسانی که به عنوان مهندسان برق آموزش دیدهاند. ما فقط یک بار و با چند تغییر در برنامهی درسی، نیازی به آمادهسازی نیروی کار خود نداریم. با بلوغ هوش مصنوعی، به نیروی کار پاسخگو نیاز خواهیم داشت که بتواند هر چند سال یکبار با فرآیندها، سیستمها و ابزار جدید سازگار شود. نیاز به این زمینهها سریعتر از آن چیزی است که ادارات کار، مدارس و دانشگاههای ما اذعان دارند. نگاه کردن به گذشته از دریچهی حال و نادیده گرفتن ناآرامیهای اجتماعی ناشی از بیکاری گستردهی ناشی از فناوری، آسان است. ما باید به یک حقیقت دشوار که تعداد کمی حاضرند آشکارا آن را بیان کنند، بپردازیم.

هوش مصنوعی در نهایت باعث میشود تعداد زیادی از مردم برای همیشه از کار بیکار شوند. همانطور که نسلهای قبل شاهد تغییرات اساسی در دوران انقلاب صنعتی و پس از آن بودند، سرعت بالای فناوری به احتمال زیاد به این معنی است که نسل انفجار جمعیت و مسنترین اعضای نسل ایکس – به ویژه کسانی که مشاغل آنها توسط رباتها قابل تکرار است – بدون سرمایهگذاری قابل توجه زمان و تلاش، قادر به بازآموزی برای انواع دیگر کار نخواهند بود.»

«بری چوداکوف»، بنیانگذار و مدیر ارشد سِرتیِن ریسرچ: «تا سال ۲۰۳۰، همکاری انسان و ماشین/هوش مصنوعی برای مدیریت و مقابله با اثرات چندین شتاب همزمان، از جمله پیشرفت گستردهی فناوری، جهانیسازی، تغییرات آب و هوایی و مهاجرتهای جهانی همراه آن، یک ابزار ضروری است. در گذشته، جوامع انسانی از طریق غریزه و شهود، تغییر را مدیریت میکردند، اما همانطور که اریک تلر، مدیرعامل گوگل ایکس، گفته، “ساختارهای اجتماعی ما نتوانستهاند با سرعت تغییر همگام شوند.” برای همگام شدن با آن تغییر و مدیریت فهرستی در حال رشد از “مشکلات بغرنج” تا سال ۲۰۳۰، هوش مصنوعی – یا با استفاده از عبارت جوی ایتو، هوش گسترده ارزش تقریباً تمام حوزههای رفتار و تعامل انسان را ارزیابی و بازارزیابی خواهد کرد. هوش مصنوعی و فناوریهای پیشرفته چارچوب پاسخ و چارچوب زمانی ما را تغییر میدهد (که به نوبه خود، حس زمان ما را هم عوض میکند).

در گذشته که تعاملات اجتماعی در مکانهایی مانند محل کار، مدرسه، کلیسا و محیطهای خانوادگی رخ میداد، تعاملات اجتماعی به طور فزایندهای در زمان مداوم و همزمان اتفاق خواهد افتاد. اگر خوششانس باشیم، از ۲۳ اصل آسیلومار هوش مصنوعی که توسط مؤسسهی آیندهی زندگی ترسیم شده است، پیروی خواهیم کرد و به سمت “نه هوش بدون جهت، بلکه هوش سودمند خواهیم رفت.” مشابه بازدارندگی هستهای که از اطمینان به نابودی متقابل ناشی میشود، هوش مصنوعی و سیستمهای فناوری مرتبط، نیرویی برای یک رنسانس اخلاقیاند.

ما باید آن رنسانس اخلاقی را در آغوش بگیریم، یا با معضلاتی اخلاقی روبهرو شویم که میتواند منجر به نابودی انسان شود. … بزرگترین امید من برای همکاری انسان و ماشین/هوش مصنوعی، یک رنسانس اخلاقی و معنوی است – ما یک ذهنیت بلندپروازانه پیش میگیریم و برای اتفاقهای پرشتابی که به سمت ما میآیند، با هم متحد میشویم. بزرگترین ترس من این است که بدون تفکر یا پاسخ هوشمندانه با این پدیدههای مواجه شویم. برای نمونه در شبکه شاهد پاسخ فوری و احساسی، انزوا و انفعال پشت صفحه نمایش، مقایسه بیپایان ارزش خود با دیگر کاربران، خودنماییهای جعلی و… هستیم.

«جان سی. هاونز»، مدیر اجرایی ابتکار جهانی اخلاق سیستمهای خودمختار و هوشمند مؤسسهی مهندسان برق و الکترونیک (IEEE) و شورای هوش گسترده: «اکنون، در سال ۲۰۱۸، بیشتر مردم جهان نمیتوانند به دادههای خود دسترسی داشته باشند، بنابراین هر بحثی دربارهی «تکمیل انسان با هوش مصنوعی» زمینهی مهم کنترل اطلاعات و هویت افراد را نادیده میگیرد. به زودی شناسایی هر سیستم خودمختار یا هوشمندی که الگوریتمهایش به شکلی با دادههای انسانی در ارتباط نباشد، بسیار دشوار خواهد شد.»

«باتیا فریدمن»، استاد تعامل انسان و رایانه در دانشکدهی اطلاعات دانشگاه واشنگتن: «تواناییهای علمی و فناورانهی ما از تواناییهای اخلاقیمان فراتر رفته و همچنان فراتر هم میرود– یعنی توانایی استفادهی عاقلانه و انسانی از دانش و ابزارهایی که توسعه میدهیم. … جنگ خودکار – زمانی که سلاحهای خودکار بدون دخالت انسان، انسانها را میکشند – میتواند منجر به عدم پذیرش مسئولیت برای گرفتن جان دشمن یا حتی عدم آگاهی از کشته شدن دشمن شود. چیزی کمتر از نوع جامعهای که میخواهیم در آن زندگی کنیم و چگونگی تجربهی انسانیتمان در خطر است.»

«گرگ شانن»، دانشمند ارشد بخش CERT در دانشگاه کارنِگی مِلون: «بهبود و بدتر شدن با نسبت چهار به یک و نسبت بلندمدت دو به یک ظاهر خواهد شد. هوش مصنوعی برای کارهای تکراری که برای انجام دادنشان «تقریباً» بودن و حضور شما کافی است (و انسانها هم از آن کارها بیزارند)، عملکرد خوبی خواهد داشت. … همانطور که برنامههای کاربردی سلامت به طور هوشمندانهای ما را به سمت سلامتی سوق میدهند، هشدارهایی در مورد رویدادهای قریبالوقوع قلبی/سکته مغزی صادر میکنند و مراقبتهای بهداشتی خودکار را برای افراد کمبرخوردار (مناطق دوردست) و کسانی که نیاز به مراقبت طولانیمدت دارند (مراقبت از سالمندان) ارائه میدهند، قطعاً زندگی بهتر میشود.

در مورد آزادی، خطرات آشکاری وجود دارد. هوش مصنوعی با ایجاد موجوداتی با قابلیتهای فکری معنادار برای نظارت، اعمال و حتی مجازات افراد بر قدرت اختیار تأثیر میگذارد. کسانی که میدانند چگونه از آن استفاده کنند، قدرت بالقوهی عظیمی نسبت به کسانی خواهند داشت که نمیدانند یا نمیتوانند از آن استفاده کنند. خوشبختی آینده واقعاً نامشخص است. برخی افراد کنترل خود را در بازیها، کار و جامعه به هوش مصنوعی واگذار خواهند کرد، درست همانطور که بحران مواد افیونی امروزه کنترل را از افراد سلب میکند. از طرف دیگر، بسیاری از کارهای معمولی و خستهکننده رها خواهند شد. اگر عناصری از خوشبختی جامعه بخشی از اهداف هوش مصنوعی باشد، پس هوش مصنوعی میتواند انفجاری از خوشبختی را به وجود آورد.»

«کوستاس الکساندریس»، نویسندهی کتاب «بررسی دینامیکهای پیچیده در سیستمهای هوشمند مبتنی بر چندین عامل» : «بسیاری از تصمیمات روزمرهی ما با حداقل دخالت کاربر نهایی خودکار خواهند شد. استقلال و/یا آزادی، فدای راحتی انسان میشود و نسلهای جدید شهروندان به ساختارها و فرآیندهای هوش مصنوعی شبکهای وابستهتر خواهند شد. چالشهایی وجود دارد که در زمینه تفکر انتقادی و ناهمگنی نیاز به رسیدگی دارد. وابستگی متقابل شبکهای به احتمال زیاد آسیبپذیری ما را در برابر حملات سایبری افزایش میدهد. همچنین احتمال زیادی وجود دارد که شکافهای عمیقتری بین «دارا» و «ندار» دیجیتال و همچنین بین زیرساختهای دیجیتالی وابسته به فناوری ایجاد شود. در نهایت، مسئلهی مالکیت و کنترل «قلههای فرماندهی» زیرساخت شبکهی دیجیتال وجود دارد.»

اسکار گاندی، استاد بازنشستهی ارتباطات در دانشگاه پنسیلوانیا: «ما از همان ابتدا با یک فرضیهی بدون پشتوانه مواجه هستیم، زمانی که از ما خواسته میشود «همکاری» انسان و ماشین را تصور کنیم. تعامل کمی متفاوت است، اما همچنان با اعطای نوعی هویت – شاید حتی شخصیت – به ماشینهایی که برای عبور از انواع فرصتها و چالشها از آنها استفاده خواهیم کرد، لکهدار شده است.»

همانطور که در حال حاضر با تکیه بر «دیگران» (از جمله سیستمهای فناوری، وسایل و شبکهها) برای به دست آوردن چیزهایی که برایشان ارزش قائل هستیم و اجتناب از چیزهای دیگر (که ممکن است از آنها آگاه باشیم یا نباشیم) با مشکلاتی روبهرو هستیم، مشکلات آینده نیز بسیار شبیه هستند.»

«جیمز اسکوفیلد اورورک»، استاد مدیریت در دانشگاه نوتردام: «فناوری در طول تاریخ ثبتشده، عمدتاً مفهومی بیطرف بوده است. ارزش آن همیشه به کاربردش بستگی داشته است. هوش مصنوعی و سایر پیشرفتهای فناورانه برای چه هدفی به کار خواهند رفت؟ از باروت گرفته تا موتورهای احتراق داخلی و شکافت هستهای، همگی به روشهای مفید و مخرب به کار گرفته شدهاند. با فرض اینکه بتوانیم هوش مصنوعی را مهار یا کنترل کنیم (و نه برعکس)، اینکه آیا اوضاع ما بهتر شود، کاملاً به ما (یا نسلهای آیندهی ما) بستگی دارد. «دوست عزیز بروتوس، دست تقصیر از آستین ستارگان بیرون نمیآید، این ماییم که انگار التماس میکنیم زیر سلطه باشیم .»

«سایمون بیگز»، استاد هنرهای بینرشتهای در دانشگاه ادینبورگ: «هوش مصنوعی برای تقویت تواناییهای انسان عمل خواهد کرد. مشکل نه هوش مصنوعی، بلکه انسان است. ما به عنوان یک گونه، پرخاشگر، رقابتی و تنبل هستیم. اما همچنین همدل، جامعهمحور و (گاهی!) فداکار هم هستیم. ما ویژگیهای بسیاری دیگر نیز داریم. همه اینها تقویت خواهند شد. با توجه به سوابق تاریخی، باید فرض کنیم که بدترین ویژگیهای ما تقویت خواهند شد. انتظار من این است که در سال ۲۰۳۰ از هوش مصنوعی به طور معمول برای جنگیدن و کشتن انسانها استفاده شود، بسیار مؤثرتر از آنچه اکنون میتوانیم بکشیم. ما به عنوان جوامع تحت تأثیر کمتری از این موضوع قرار خواهیم گرفت، زیرا ما خودمان در حال جنگیدن و کشتن نیستیم. توانایی ما برای تغییر رفتارمان، با در نظر گرفتن همدلی و چارچوب اخلاقی مرتبط، با جدایی بین قدرت اختیار و عمل کشتن کاهش خواهد یافت. نمیتوانیم انتظار داشته باشیم که سیستمهای هوش مصنوعی ما به جای ما اخلاقی باشند – آنها نخواهند بود، زیرا برای کشتن کارآمد طراحی شدهاند، نه کشتن متفکرانه.

نگرانیِ مهمِ دیگرم در مورد نظارت و کنترل است. ظهور سیستم اعتبار اجتماعی چین (SCS) نشاندهندهی آن چیزی است که به احتمال زیاد در آینده اتفاق خواهد افتاد. ما درون یک SCS وجود خواهیم داشت، در حالی که هوش مصنوعی نمونههای ترکیبی از خودمان را میسازد که ممکن است شبیه به ما باشند یا نباشند. اما حقوق و امکانات ما به عنوان افراد توسط SCS تعیین خواهد شد.»

«مارک سرمن»، مدیر اجرایی بنیاد موزیلا: «هوش مصنوعی همچنان به تمرکز قدرت و ثروت در دست چند انحصار بزرگ مستقر در آمریکا و چین ادامه خواهد داد. بیشتر مردم – و بخشهایی از جهان – وضعیت بدتری خواهند داشت.»

«ویلیام اوریکچیو»، پژوهشگر رسانه و استاد مطالعات تطبیقی رسانه در MIT: «هوش مصنوعی و کاربردهای مرتبط با آن با سه مشکل روبهروست:

۱. توسعه با سرعت قانون مور

2. توسعه در دست [عدهای از] نخبگان فناورانه و اقتصادی

3. توسعه بدون بهرهمندی از یک جامعه مطلع یا درگیر.

مردم به مجموعهای از مصرفکنندگانی تقلیل یافتهاند که منتظر فناوری بعدی هستند. مفهوم «پیشرفت» چه کسی [یا کدام گروه فکری] غالب خواهد شد؟ شواهد زیادی وجود دارد که هوش مصنوعی برای کسب سود، بدون توجه به پیامدهای آن استفاده میشود. مثلاً [به] ارزشهای دیرینهسال انسان [بیتوجهی میکند]؛ [از این ابزار] برای تقویت کنترل دولتی میتوان استفاده کرد. حتی از آن میتوان برای امتیازدهی «اعتبار اجتماعی» شهروندان بدون مشارکت خود شهروندان، سوءاستفاده کرد.

هوش مصنوعی مانند فناوریهای پیش از خود، بیطرف است. دستان جامعه آن را پرورش میدهد و سرپا میکند. اما در غیاب یک جامعه باسواد در زمینهی هوش مصنوعی، تصمیمگیری در مورد بهترین شیوهی استقرار هوش مصنوعی به منافع خاص واگذار میشود. آیا این به معنای استقرار عادلانه، کاهش بیعدالتی اجتماعی و هوش مصنوعی در خدمت مردم خواهد بود؟ از آنجایی که پاسخ به این سوال اجتماعی است نه فناورانه، من بدبین هستم. راهحل؟ ما نیاز به توسعهی یک جامعهی باسواد در زمینهی هوش مصنوعی داریم، که به معنای توجه ویژه در بخش آموزشی و رسانههای عمومی است. ما باید تنوع را در توسعهی فناوریهای هوش مصنوعی تضمین کنیم. و تا زمانی که مردم، نمایندگان منتخب آنان و رژیمهای حقوقی و نظارتیشان بتوانند با این تحولات سریع همگام شوند، باید در توسعهی هوش مصنوعی احتیاط و نظارت را اعمال کنیم.»

بخش باقیماندهی این گزارش به سه بخش تقسیم میشود که از مشاهدات امیدوارکننده و انتقادی صدها پاسخدهندهی دیگر حاصل شده است:

۱) نگرانیها در مورد تکامل انسان و هوش مصنوعی

۲) راهحلهای پیشنهادی برای رسیدگی به تأثیر هوش مصنوعی

۳) انتظاراتی که از زندگی در سال ۲۰۳۰ وجود دارد، از جمله چشماندازهای مثبت پاسخدهندگان نسبت به کیفیت زندگی و آیندهی کار، مراقبتهای بهداشتی و آموزش.